我們經(jīng)常聽到客戶問如下問題:原生開源大模型就能OCR識別,為什么要采購易道博識二次訓(xùn)練的OCR大模型,價值在哪?

事實(shí)上,在未經(jīng)調(diào)優(yōu)的情況下,直接將原生大模型用于OCR識別,很難滿足生產(chǎn)要求。

大模型OCR的技術(shù)路徑與固有局限

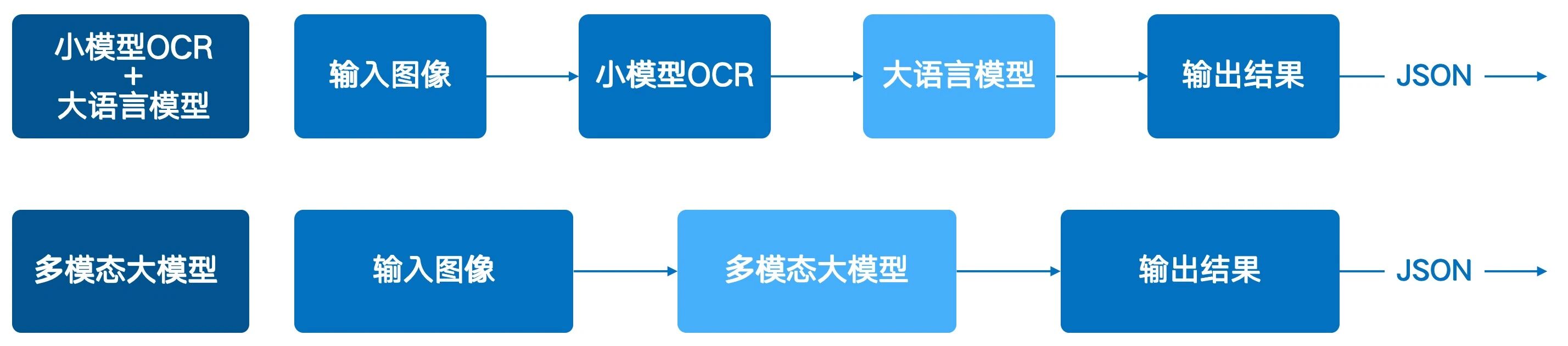

大模型實(shí)現(xiàn)OCR功能主要通過兩種技術(shù)路徑,兩者在架構(gòu)上決定了其在實(shí)際應(yīng)用中的固有局限。

多模態(tài)大模型:多模態(tài)大模型是“圖像輸入→文本輸出” 的端到端解決方案。模型通過統(tǒng)一的架構(gòu)直接理解圖像中的視覺特征(如文字、布局)和語義信息,一步完成識別與信息提取。

當(dāng)原生大模型在應(yīng)用于專業(yè)的OCR任務(wù)時,暴露出以下局限:

1、識別準(zhǔn)確率不足

● 字符識別:在手寫體、印刷質(zhì)量不佳或存在生僻字的情況下,識別錯誤率較高。

● 表格識別:對于包含合并單元格或復(fù)雜排版的表格,結(jié)構(gòu)識別和內(nèi)容提取的準(zhǔn)確率會大幅下降。

● 數(shù)據(jù)提取:當(dāng)文檔中缺少明確的關(guān)鍵字作為定位錨點(diǎn)時,模型提取特定字段的準(zhǔn)確性顯著降低。

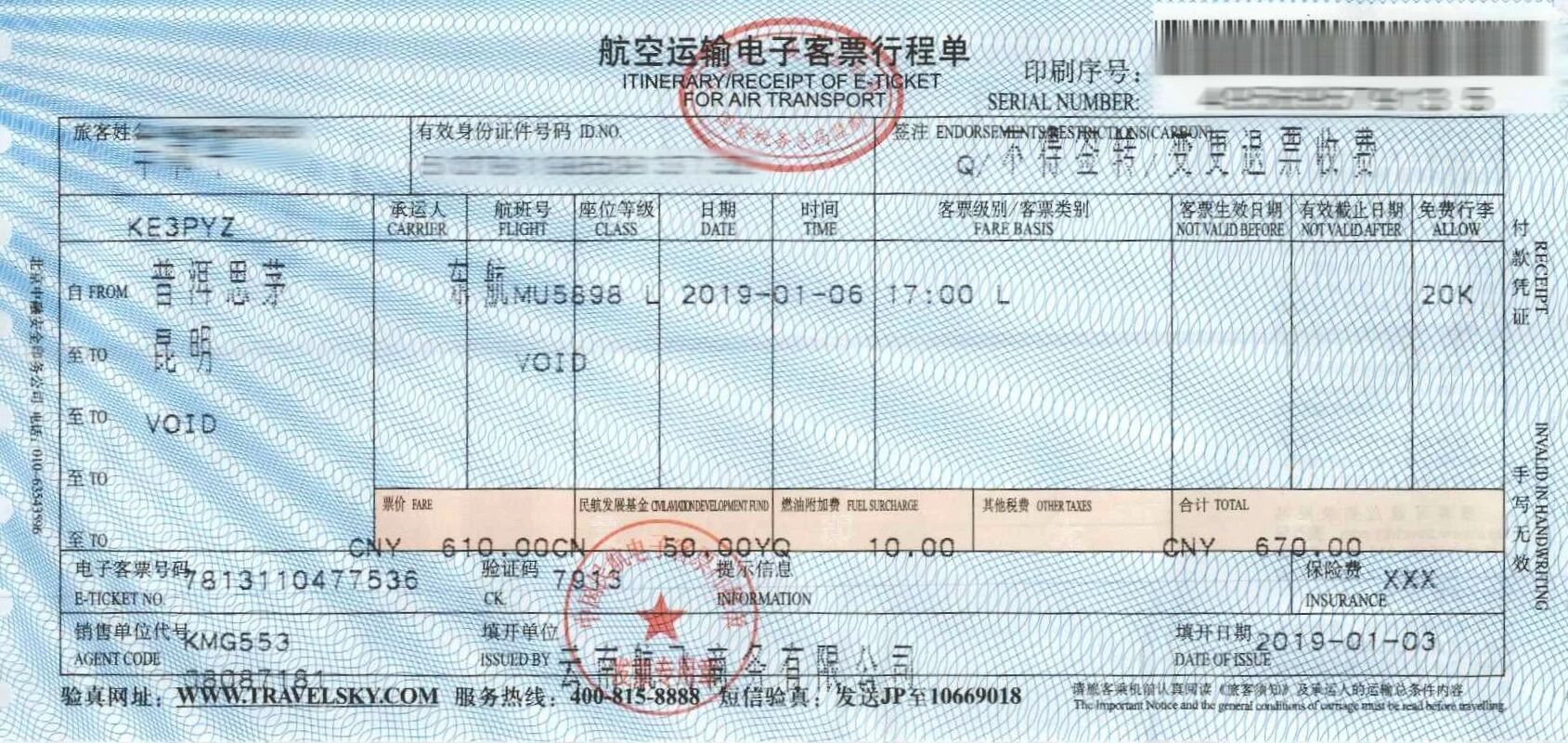

● 版式兼容性:在企業(yè)的財務(wù)流程中,發(fā)票、銀行回單、結(jié)算憑證等套打文檔無處不在,然而,一旦打印過程出現(xiàn)物理偏移,例如,發(fā)票上的關(guān)鍵字段“金額”或“收款人”未能精確打印在預(yù)設(shè)的表格框線內(nèi),模型便難以識別。

2、存在幻覺

“幻覺”是指模型生成了與圖像實(shí)際內(nèi)容不符但看似合理的結(jié)果。

● 語義覆蓋內(nèi)容:當(dāng)圖像文字模糊時,模型可能依據(jù)上下文“腦補(bǔ)”出錯誤但符合邏輯的內(nèi)容。例如,將模糊的金額“198”識別為更常見的“199”。

● 無中生有:對于圖像中本應(yīng)為空白的字段,模型可能會強(qiáng)制生成內(nèi)容。

● 長文本連貫性幻覺:對于長段落文本(如書籍掃描頁),大模型為保證輸出文本的連貫性,可能對個別識別模糊的詞進(jìn)行 “合理化修正”,導(dǎo)致局部文本與原圖不符。

3、識別結(jié)果無法溯源

原生大模型在識別文本后,通常不提供其在原始圖像中的具體坐標(biāo)位置,導(dǎo)致識別結(jié)果無法溯源。

這一局限在實(shí)際應(yīng)用中會帶來兩類關(guān)鍵問題:

操作層面,當(dāng)識別結(jié)果出錯時,用戶無法快速定位原文進(jìn)行人工校對;

合規(guī)層面,尤其在金融、醫(yī)療等監(jiān)管嚴(yán)格的領(lǐng)域,審計要求OCR結(jié)果必須與原始憑證的原文精確對應(yīng),因此,缺乏坐標(biāo)溯源能力的技術(shù)無法滿足其合規(guī)標(biāo)準(zhǔn)。

4、精度與成本難平衡

模型精度與其參數(shù)規(guī)模正相關(guān)。千億級參數(shù)的大模型能達(dá)到更高的識別精度,但其推理計算必須依賴A100/H100級別的高端GPU,這使得硬件部署成本十分高昂。

反之,如果為了控制成本而采用參數(shù)裁剪或量化壓縮后的輕量化模型,會導(dǎo)致跨模態(tài)注意力機(jī)制、視覺特征編碼能力受損,OCR 精度大幅下降。例如,某多模態(tài)模型的 7B 參數(shù)版本在表格識別任務(wù)中的準(zhǔn)確率比 130B 版本低 20% 以上。

為克服原生大模型的局限,易道博識采用“選擇模型與評測短板 - 定向訓(xùn)練 - 驗(yàn)證效果”的閉環(huán)流程,對基礎(chǔ)大模型進(jìn)行二次訓(xùn)練與調(diào)優(yōu)。

1. 選擇與評測基礎(chǔ)模型: 首先,根據(jù)任務(wù)需求(如場景、語言、精度要求)選擇一個基礎(chǔ)大模型。在調(diào)優(yōu)前,對其OCR能力進(jìn)行全面評測,包括在印刷體、手寫體、不同噪聲背景下的文本識別準(zhǔn)確率,以及表格識別和上下文理解能力,從而定位其具體短板,為后續(xù)訓(xùn)練數(shù)據(jù)的篩選和調(diào)優(yōu)策略(如重點(diǎn)強(qiáng)化手寫體數(shù)據(jù)的訓(xùn)練)提供指導(dǎo)。

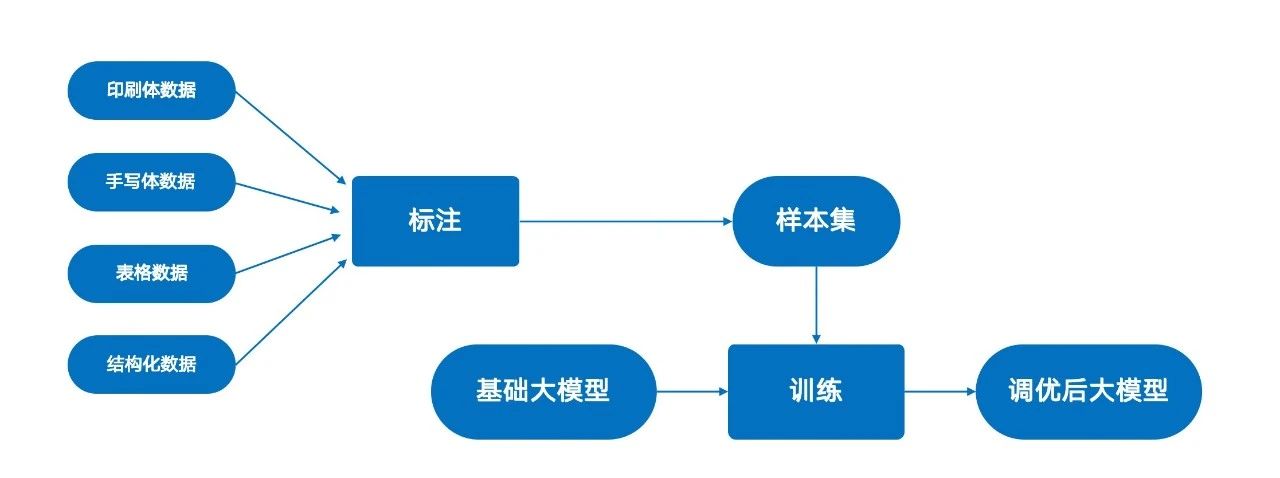

2. 定向數(shù)據(jù)訓(xùn)練: 基于評測結(jié)果,構(gòu)建針對性的訓(xùn)練數(shù)據(jù)集。簡單來說,大模型在哪方面能力偏差,就要相應(yīng)的增加相關(guān)訓(xùn)練數(shù)據(jù)。

例如,若模型對手寫體識別能力較弱,則在訓(xùn)練數(shù)據(jù)中增加手寫樣本的比例。我們使用海量經(jīng)過專業(yè)標(biāo)注的OCR數(shù)據(jù),覆蓋印刷體、手寫體、各類表格及結(jié)構(gòu)化文檔,對基礎(chǔ)大模型進(jìn)行二次訓(xùn)練,以增強(qiáng)其在特定任務(wù)上的特征學(xué)習(xí)能力。

3. 評估與驗(yàn)證: 訓(xùn)練完成后,在獨(dú)立的測試集上對調(diào)優(yōu)后模型的各項性能指標(biāo)進(jìn)行重新評估,以驗(yàn)證其相較于原生模型的提升,最終實(shí)現(xiàn)高精度、高魯棒性的 OCR 應(yīng)用。

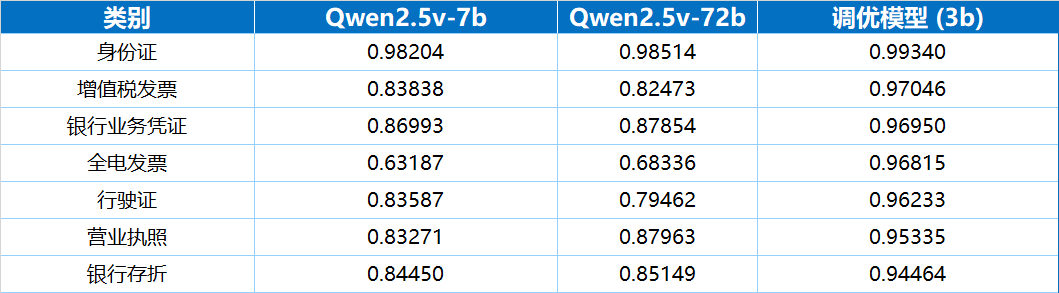

通過二次訓(xùn)練,模型在準(zhǔn)確率、速度和功能完備性上均獲得了顯著提升。最為重要的是,基于相對輕量化的大模型,經(jīng)過二次訓(xùn)練,其OCR綜合能力要遠(yuǎn)好于更大參數(shù)規(guī)模的原生大模型,

丨準(zhǔn)確率:30億參數(shù)模型優(yōu)于720億參數(shù)模型

評測結(jié)果顯示,一個30億參數(shù)的多模態(tài)大模型經(jīng)過二次訓(xùn)練后,其在多種真實(shí)業(yè)務(wù)票據(jù)上的端到端識別準(zhǔn)確率,不僅高于70億參數(shù)的原生模型,甚至全面優(yōu)于720億參數(shù)的原生模型。

在相同的A100(80G)硬件環(huán)境下,處理同等復(fù)雜度的增值稅發(fā)票,720億參數(shù)的Qwen模型平均耗時21.43秒,而調(diào)優(yōu)后的30億參數(shù)模型僅需3.23秒,處理速度為前者的6.63倍。

此外,通過并行任務(wù)設(shè)計和工程上的優(yōu)化,進(jìn)一步加速了大模型推理:在信息抽取任務(wù)上,將實(shí)體抽取、表格抽取任務(wù)拆開并行計算,理論速度可再提升最高100%。

與原生大模型不同,經(jīng)過二次訓(xùn)練的模型支持輸出每個識別字段在原始圖像中的精確坐標(biāo)。這一功能解決了結(jié)果無法溯源的問題,滿足了業(yè)務(wù)核驗(yàn)與合規(guī)審計的需求。

為降低大模型在業(yè)務(wù)系統(tǒng)中的使用門檻,我們進(jìn)行了兩項關(guān)鍵的工程化改造。

大模型與普通 OCR 接口在輸入輸出邏輯上存在顯著差異:

傳統(tǒng) OCR 接口采用 "圖像→結(jié)構(gòu)化數(shù)據(jù)" 的固定模式,通常僅接收圖像輸入,輸出包含文字內(nèi)容及位置信息的 JSON 格式數(shù)據(jù)。

原生大模型采用“圖像+提示詞”的協(xié)同輸入模式,其優(yōu)勢在于能進(jìn)行深度語義理解,實(shí)現(xiàn)更精準(zhǔn)的信息提取。

然而,這一模式也帶來了兩個問題:一是要求用戶具備為不同文檔設(shè)計提示詞的能力,二是其流式輸出與標(biāo)準(zhǔn)的JSON格式不兼容,這都顯著增加了非專業(yè)用戶的使用門檻。

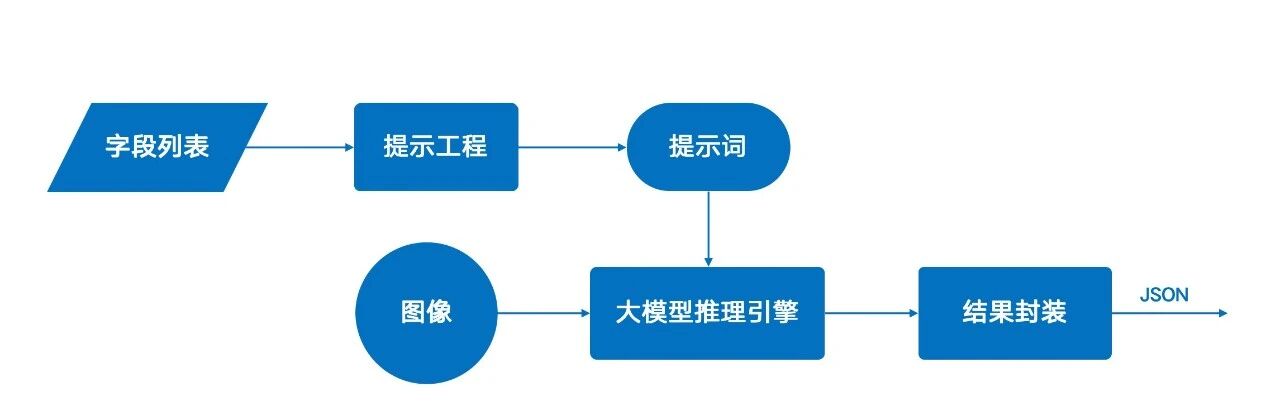

為此,易道博識通過工程化手段,將復(fù)雜的調(diào)用邏輯封裝成標(biāo)準(zhǔn)API。用戶只需提供圖像和待提取的字段列表,系統(tǒng)即可自動構(gòu)建提示詞并返回結(jié)構(gòu)化的JSON結(jié)果,其使用體驗(yàn)與傳統(tǒng)OCR接口一致。

由于用戶無需自行定義復(fù)雜的提示詞,也無需處理復(fù)雜的和大模型的交互過程,因而接口更加方便易用。

從當(dāng)前技術(shù)實(shí)踐來看,大模型更多是對小模型的有益補(bǔ)充,而非全然替代。二者的深度融合,才是現(xiàn)階段應(yīng)對復(fù)雜場景的最優(yōu)解。

需要注意的是,原生狀態(tài)下的大模型與小模型往往難以實(shí)現(xiàn)深度協(xié)同 。傳統(tǒng)解決方案多采用獨(dú)立部署模式,在應(yīng)用層根據(jù)具體需求分別調(diào)用大模型或小模型的接口,這種方式難以突破 “各自為戰(zhàn)” 的局限。

而易道博識通過系統(tǒng)化的工程化手段,成功實(shí)現(xiàn)了大小模型的深度融合,智能文檔處理平臺(簡稱DeepIDP)架構(gòu)如下:

DeepIDP在底層集成了小模型推理引擎和大型模型推理引擎。該架構(gòu)可以根據(jù)任務(wù)的復(fù)雜度和需求,自動調(diào)度最合適的模型進(jìn)行處理,對外提供標(biāo)準(zhǔn)化的服務(wù)接口。

這種融合架構(gòu)屏蔽了底層模型的差異,實(shí)現(xiàn)了“無感調(diào)用”,用戶無需刻意區(qū)分某個識別能力是由大模型還是小模型提供,只需專注于自身業(yè)務(wù)需求即可。

在確保高性能和高效率的同時,簡化了系統(tǒng)維護(hù),為業(yè)務(wù)創(chuàng)新提供了更靈活的底層AI能力支持。